【Vercel】为什么推送了提交之后,网站没有自动部署?

在Vercel上,每次向Github项目push时会自动部署,免费账户每天限100次。公共库的所有PR都会触发部署,但私有库仅限团队成员的推送。判断依据是提交者的邮箱地址,需确保与Vercel团队成员邮箱匹配。要修改git邮箱,可参考相关配置文章,然后在Vercel后台邀请用户加入团队。

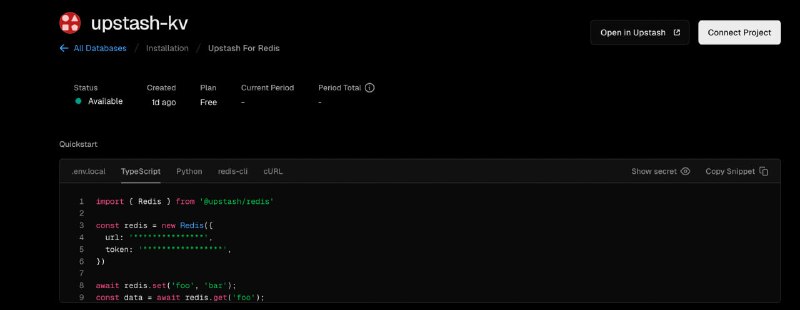

通常,在 Vercel 上部署了一个 Github 上的项目,每次 git push 的时候,就自动触发部署,Vercel 把部署过程做得很丝滑。如果频繁提交,还要注意不要超过部署额度,免费账户每天的部署次数最多100次。

对于 Github 上的公开库,任何人推送或合并 PR,都将触发自动部署。但对于私有库,只有 Vercel 上团队成员的推送才会触发自动部署。也就是说,非团队成员推送提交到私有库,不会触发自动部署。

Vercel 怎么判断一个推送提交者是不是团队成员呢?唯一的判断是改提交用户的邮箱地址。如何修改git用户邮箱地址,可以参考这篇文章:【git】配置邮箱地址及用户名。

修改好git用户邮箱之后,就可以在 Vercel 项目管理后台,邀请用户加入团队。

#programming

在Vercel上,每次向Github项目push时会自动部署,免费账户每天限100次。公共库的所有PR都会触发部署,但私有库仅限团队成员的推送。判断依据是提交者的邮箱地址,需确保与Vercel团队成员邮箱匹配。要修改git邮箱,可参考相关配置文章,然后在Vercel后台邀请用户加入团队。

通常,在 Vercel 上部署了一个 Github 上的项目,每次 git push 的时候,就自动触发部署,Vercel 把部署过程做得很丝滑。如果频繁提交,还要注意不要超过部署额度,免费账户每天的部署次数最多100次。

对于 Github 上的公开库,任何人推送或合并 PR,都将触发自动部署。但对于私有库,只有 Vercel 上团队成员的推送才会触发自动部署。也就是说,非团队成员推送提交到私有库,不会触发自动部署。

Vercel 怎么判断一个推送提交者是不是团队成员呢?唯一的判断是改提交用户的邮箱地址。如何修改git用户邮箱地址,可以参考这篇文章:【git】配置邮箱地址及用户名。

修改好git用户邮箱之后,就可以在 Vercel 项目管理后台,邀请用户加入团队。

#programming